Was würde passieren, wenn man eine virtuelle, simulierte Welt mit künstlichen Intelligenzen bevölkert und sie freilässt? Es stellt sich heraus, dass sie sich die Zähne putzen und sehr nett zueinander sind! Aber dieses wenig aufregende Ergebnis ist eine gute Nachricht für die Forscher, die das Experiment durchgeführt haben, denn sie wollten „glaubwürdige Simulationen menschlichen Verhaltens“ erzeugen und haben genau das erreicht. Das Papier, in dem das Experiment von Forschern aus Stanford und Google beschrieben wird, wurde weder von Gutachtern geprüft noch zur Veröffentlichung angenommen, ist aber dennoch interessant zu lesen. Die Idee war, zu sehen, ob sie die neuesten Fortschritte im Bereich des maschinellen Lernens anwenden können, um „generative Agenten“ zu entwickeln, die ihre Umstände aufnehmen und eine realistische Handlung als Reaktion darauf ausgeben.

Inhaltsverzeichnis

Und genau das ist ihnen gelungen. Doch bevor Sie sich von den niedlichen Bildern und Beschreibungen von Reflexion, Konversation und Interaktion verführen lassen, sollten Sie verstehen, dass das, was hier passiert, eher einem Rollenspiel einer Improvisationstruppe auf einem MUD ähnelt als einer Art Proto-Skynet. (Nur Millennials werden den vorangegangenen Satz verstehen.) Diese kleinen Figuren sind nicht ganz das, was sie zu sein scheinen. Die Grafiken sind nur eine visuelle Darstellung dessen, was im Wesentlichen eine Reihe von Unterhaltungen zwischen mehreren Instanzen von ChatGPT ist. Die Agenten laufen nicht nach oben, unten, links und rechts oder nähern sich einem Schrank, um mit ihm zu interagieren. All dies geschieht über eine komplexe und verborgene Textebene, die die Informationen zu den einzelnen Agenten zusammenfasst und organisiert.

Wie funktioniert die simulierte Welt?

Fünfundzwanzig Agenten, 25 Instanzen von ChatGPT, jeder mit ähnlich formatierten Informationen, die ihn veranlassen, die Rolle einer Person in einer fiktiven Stadt zu spielen. Eine solche Person, John Lin, ist folgendermaßen aufgebaut: John Lin ist ein Apotheker im Willow Market and Pharmacy, der es liebt, Menschen zu helfen. Er ist immer auf der Suche nach Möglichkeiten, seinen Kunden die Beschaffung von Medikamenten zu erleichtern; John Lin lebt mit seiner Frau Mei Lin, die Hochschulprofessorin ist, und seinem Sohn Eddy Lin, der Musiktheorie studiert, zusammen; John Lin liebt seine Familie sehr; John Lin kennt das alte Ehepaar von nebenan, Sam Moore und Jennifer Moore, schon seit einigen Jahren; John Lin hält Sam Moore für einen freundlichen und netten Mann…

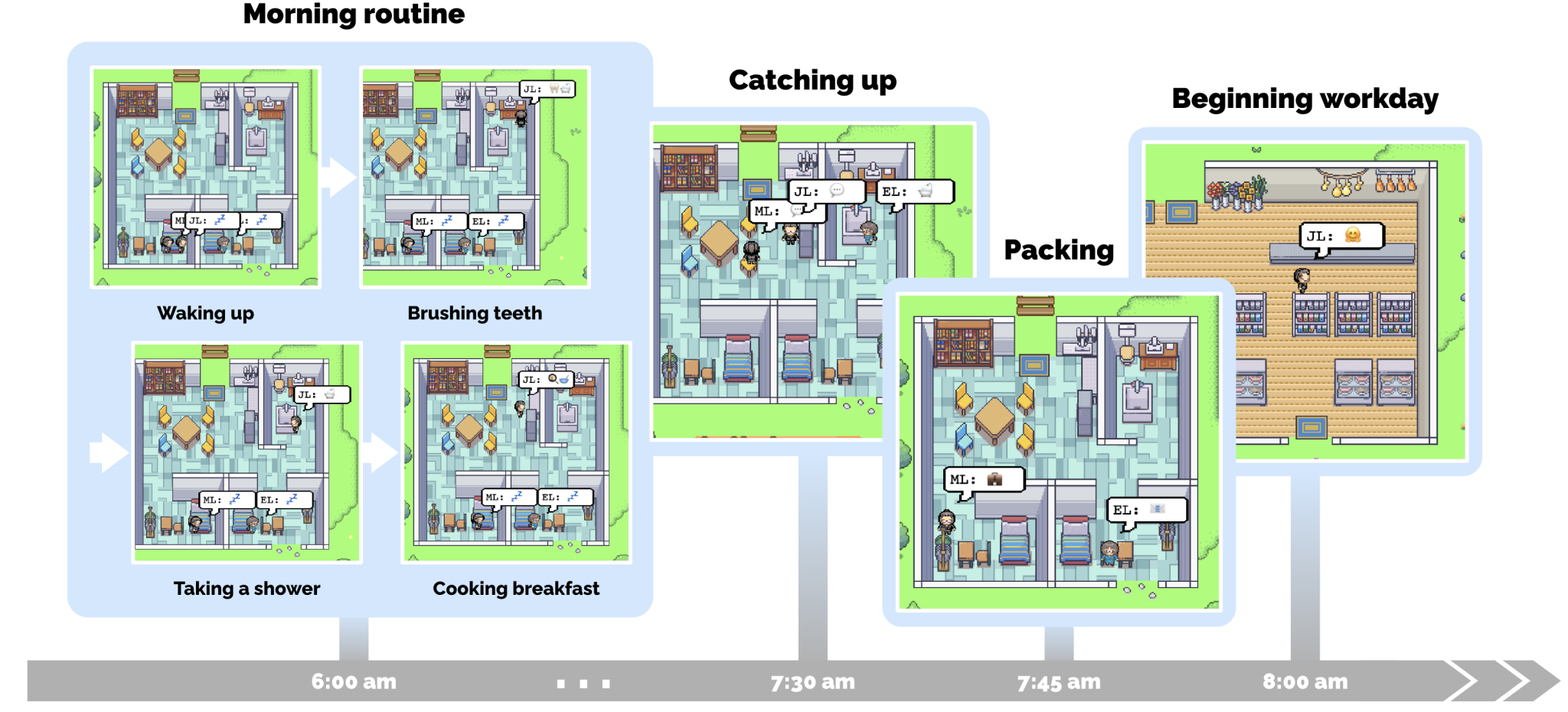

Mit diesen Informationen werden die Agenten dann gebeten, sich angesichts der Zeit und der Umstände ihre nächsten Aktionen auszudenken. Sie könnten dem Agenten John zum Beispiel sagen, dass es 8 Uhr morgens ist und er gerade aufgewacht ist. Was tut er dann? Nun, er putzt sich die Zähne, küsst seine Frau (hoffentlich in dieser Reihenfolge), zieht sich an und geht dann in die Küche. In der Zwischenzeit wurde eine andere, völlig unabhängige ChatGPT-Instanz, die Johns Sohn Eddy repräsentiert, ebenfalls mit ihren eigenen Informationen versorgt. Auch er steht auf, putzt sich die Zähne und geht dann in die Küche.

Und nun kommt die übergreifende Struktur des Experiments ins Spiel: Die Agenten, die John und Eddy repräsentieren, befinden sich nicht beide im selben virtuellen Raum oder so. Wenn John mit dem Anziehen fertig ist und sagt, dass er sich in die Küche begeben will, teilt ihm der Versuchsaufbau stattdessen mit, dass sein Sohn Eddy dort ist, weil Eddy in seiner eigenen Instanz beschlossen hat, sich zu einem sich überschneidenden Zeitpunkt des „Tages“ auf der Experiment-Ebene in die Küche zu begeben, und zwar auf der Grundlage einer Schätzung, wie lange verschiedene Aktionen dauern.

Kommunikation in Smallville

Da beide zur gleichen Zeit im Raum sind, informiert die Versuchsanordnung sie darüber, dass die andere Person dort ist – zusammen mit Informationen wie, dass es einen Tisch gibt, an dem niemand sitzt, dass der Herd an ist usw. Was tun sie als nächstes?

John: Guten Morgen Eddy. Hast du gut geschlafen?

Eddy: Guten Morgen, Papa. Ja, ich habe gut geschlafen.

John: Das ist gut. Woran arbeitest du heute?

Eddy: Ich arbeite an einer neuen Musikkomposition für meinen Kurs. Sie ist diese Woche fällig, also versuche ich, sie fertig zu bekommen. Aber ich habe so viel Spaß dabei!

John: Das klingt großartig!

Was für eine schöne, normale Interaktion zwischen Eltern und Kind. Dann kommt Mei herein und sie haben auch eine angenehme Interaktion. Und das alles wird erreicht, indem völlig unterschiedliche Chatbots gefragt werden, was sie tun würden, wenn sie in einer fiktiven Stadt, in der es sich um diese Person handelt und die eine Familie wie diese hat und sich zu dieser Zeit in einem Raum befindet, in dem dies geschieht… was würden „sie“, ein echter Mensch, tun? ChatGPT rät also, was eine Person in dieser Situation tun würde, und gibt ihre Antwort, als ob sie ein Textadventure spielen würde. Wenn man ihm dann sagen würde: „Es ist stockdunkel, du wirst wahrscheinlich von einem Wolf gefressen“, würde es wahrscheinlich sagen, dass es eine Taschenlampe anmacht. Aber stattdessen lässt das Experiment die Charaktere ihren Tag Minute für Minute weiterleben, Lebensmittel einkaufen, im Park spazieren gehen und zur Arbeit fahren.

Die Benutzer können auch Ereignisse und Umstände eingeben, wie z. B. einen tropfenden Wasserhahn oder den Wunsch, eine Party zu planen, und die Agenten reagieren entsprechend, da jeder Text für sie Realität ist. All dies geschieht durch mühsame Eingabeaufforderungen an all diese Instanzen von ChatGPT mit allen Einzelheiten der unmittelbaren Umstände des Agenten. Hier ist eine Eingabeaufforderung für John, wenn er später Eddy trifft:

Es ist der 13. Februar 2023, 16:56 Uhr.

John Lin’s Status: John ist früh von der Arbeit nach Hause gekommen.

Beobachtung: John hat gesehen, wie Eddy einen kurzen Spaziergang um seinen Arbeitsplatz gemacht hat.

Zusammenfassung des relevanten Kontextes aus Johns Gedächtnis:

Eddy Lin ist John Lin’s Sohn. Eddy Lin hat an einer Musikkomposition für seine Klasse gearbeitet. Eddy Lin geht gerne im Garten spazieren, wenn er über Musik nachdenkt oder sie hört.

John fragt Eddy nach seinem Musikkompositionsprojekt. Was würde er zu Eddy sagen?[Antwort:] Hey Eddy, wie geht es mit dem Musikkompositionsprojekt für deine Klasse voran?

Die Instanzen würden schnell anfangen, wichtige Dinge zu vergessen, da der Prozess so langwierig ist. Deshalb setzt der experimentelle Rahmen auf die Simulation auf und erinnert sie an wichtige Dinge oder fasst sie in leichter zu transportierende Teile zusammen.

Nachdem dem Agenten beispielsweise eine Situation im Park geschildert wurde, in der jemand auf einer Bank sitzt und sich mit einem anderen Agenten unterhält, es aber auch Gras und einen leeren Platz auf der Bank gibt… nichts davon ist wichtig. Was ist wichtig? Aus all diesen Beobachtungen, die für den Agenten seitenweise Text ergeben können, könnte man die „Überlegung“ anstellen, dass „Eddie und Fran Freunde sind, weil ich sie zusammen im Park gesehen habe“. Das wird in das Langzeitgedächtnis des Agenten eingetragen – ein Haufen Dinge, die außerhalb des ChatGPT-Gesprächs gespeichert werden – und der Rest kann vergessen werden.

Worauf läuft dieser ganze Wirrwarr also hinaus?

Sicherlich etwas weniger als echte generative Agenten, wie sie in dem Papier vorgeschlagen werden, aber auch ein äußerst überzeugender früher Versuch, sie zu schaffen. Dwarf Fortress macht natürlich dasselbe, aber indem es jede Möglichkeit von Hand kodiert. Das lässt sich nicht gut skalieren!

Es war nicht offensichtlich, dass ein großes Sprachmodell wie ChatGPT gut auf diese Art der Behandlung ansprechen würde. Schließlich wurde es nicht entwickelt, um beliebige fiktive Charaktere langfristig zu imitieren oder über die nervtötendsten Details des Tages einer Person zu spekulieren. Richtig gehandhabt – und mit einer gehörigen Portion Massieren – kann ein Agent dies nicht nur tun, sondern er geht auch nicht kaputt, wenn man ihn als Teil eines virtuellen Dioramas verwendet.

Dies hat potenziell enorme Auswirkungen auf die Simulation menschlicher Interaktionen, wo auch immer diese relevant sein mögen – in Spielen und virtuellen Umgebungen sind sie natürlich wichtig, aber dafür ist dieser Ansatz immer noch ungeheuer unpraktisch. Entscheidend ist jedoch nicht, dass es etwas ist, das jeder nutzen oder mit dem jeder spielen kann (obwohl es das bald sein wird, daran habe ich keinen Zweifel), sondern dass das System überhaupt funktioniert. Das haben wir bei der KI gesehen: Wenn sie etwas schlecht kann, bedeutet die Tatsache, dass sie es überhaupt kann, im Allgemeinen